近日,哈尔滨工业大学(深圳)蒋琳教授课题组的博士生沈博文作为第一作者的学术论文《SecMoE: Communication-Efficient Secure MoE Inference via Select-Then-Compute》被国际顶级学术会议 The 40th Annual AAAI Conference on Artificial Intelligence(AAAI 2026)接收。该论文的合作作者包括博士生陈宇月、鹏城实验室张宾老师、天津大学张兮教授,蒋琳教授和张宾老师分别为第一第二通讯作者,哈尔滨工业大学(深圳)为第一完成单位。

论文简介:隐私保护的 Transformer 推理由于潜在的敏感信息泄露风险而受到广泛关注。尽管近年来已经取得一定进展,但现有框架在模型参数量级方面与明文模型相比仍显不足,差距最高可达百倍。弥合这一差距的一个潜在方向是Mixture of Experts(MoE)架构,它已成为一种在仅增加极小开销的情况下扩展模型容量的有前景技术。然而,在当前安全两方计算(2-PC)混合协议中,在基于同态计算的线性层运算下被激活专家索引会被泄露给服务器,从而泄露关于客户端输入token级隐私。

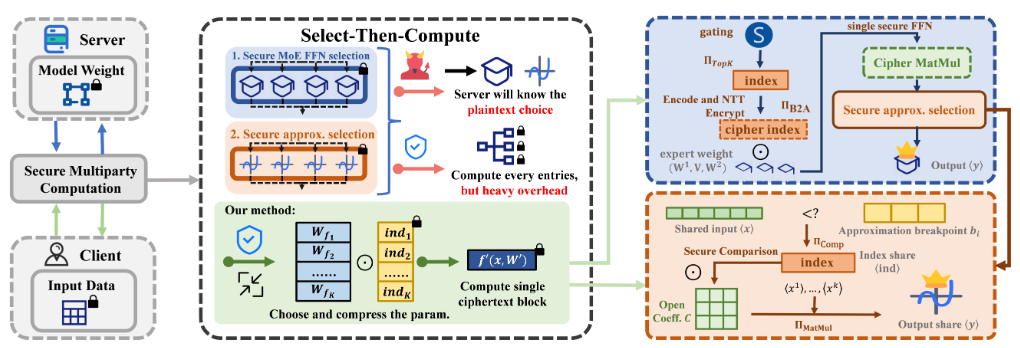

为解决上述隐私与效率难题,本文提出了一个2-PC隐私保护推理框架 SecMoE。如图1所示,通过统一MoE层各专家电路,SecMoE能够在不泄露选择信息的情况下,从电路中无泄露地选取所需参数并仅对一个密文通道进行计算,称之为 Select-Then-Compute。这一设计使得隐私推理中可支持的模型规模提升至原来的63倍,同时端到端运行效率提升15.2倍。这一思想同样被应用在非线性函数分段近似上,在平均绝对误差1.7e-3下,取得相比最先进协议有81%的通信优化。大量实验结果表明,在包含5种专家的设置下,相较于当前最先进协议,SecMoE将端到端隐私推理通信量降低1.8∼7.1倍,实现1.3∼3.8倍的加速。

图1 SecMoE整体框架

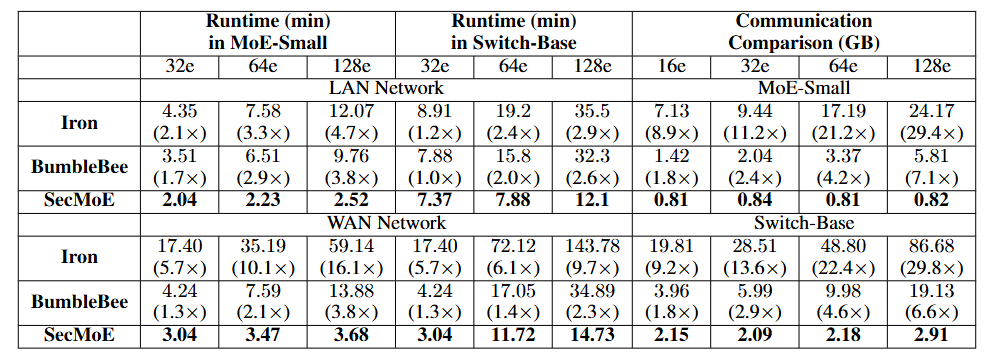

性能比较方面SecMoE与其他方案进行多专家和多网络下的比较,结果如表1所示:

表1 SecMoE与其他方案的性能比较